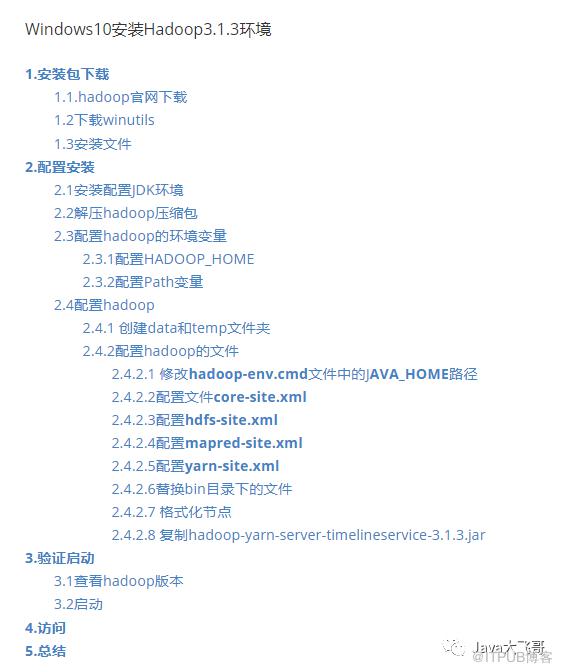

1.安装包下载

1.1.hadoop官网下载

https://hadoop.apache.org/release/3.1.3.html

1.2下载winutils

java.lang.UnsatisfiedLinkError: org.apache.hadoop.io.nativeio.NativeIO$Windows.

1.3安装文件

链接:https://pan.baidu.com/s/109956kgaarkHoklcARVYgQ

提取码:udy1

2.配置安装

2.1安装配置JDK环境

略,需要安装JDK>=1.8, jdk64位,不要安装在C盘的默认路径下:C:\Program Files\Java下,否则修改hadoop的修改hadoop-env.cmd文件中的JAVA_HOME路径会不生效,jdk的路径中不要用特殊字符、中文或者是空格,否则配置会无效,如果你的jdk环境默认安装在C:\Program Files\Java下可以将其复制一份到非C盘的盘中,然后去除路径中的空格、中文和特殊字符等符号,然后重新配置下jdk的环境变量即可,我的是之前安装在C:\Program Files\Java下,然后复制到D盘下重新配置jdk环境变量就生效了。

2.2解压hadoop压缩包

把下载的hadoop-3.1.3.tar.gz压缩包解压到自己要安装的路径下

我的解压安装路径是在D:\hadoop-3.1.3

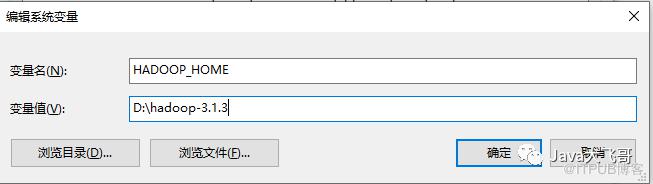

2.3配置hadoop的环境变量

2.3.1配置HADOOP_HOME

2.3.2配置Path变量

在Path变量中添加hadoop的bin路径:%HADOOP_HOME%\bin;

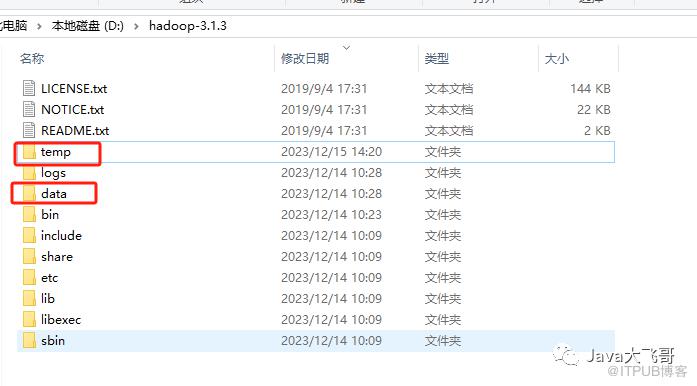

2.4配置hadoop

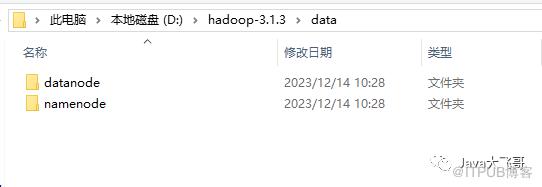

2.4.1 创建data和temp文件夹

进入hadoop的安装目录D:\hadoop-3.1.3下新建data和temp文件夹

进入data目录,创建datanode和namenode文件夹

2.4.2配置hadoop的文件

进入D:\hadoop-3.1.3\etc\hadoop

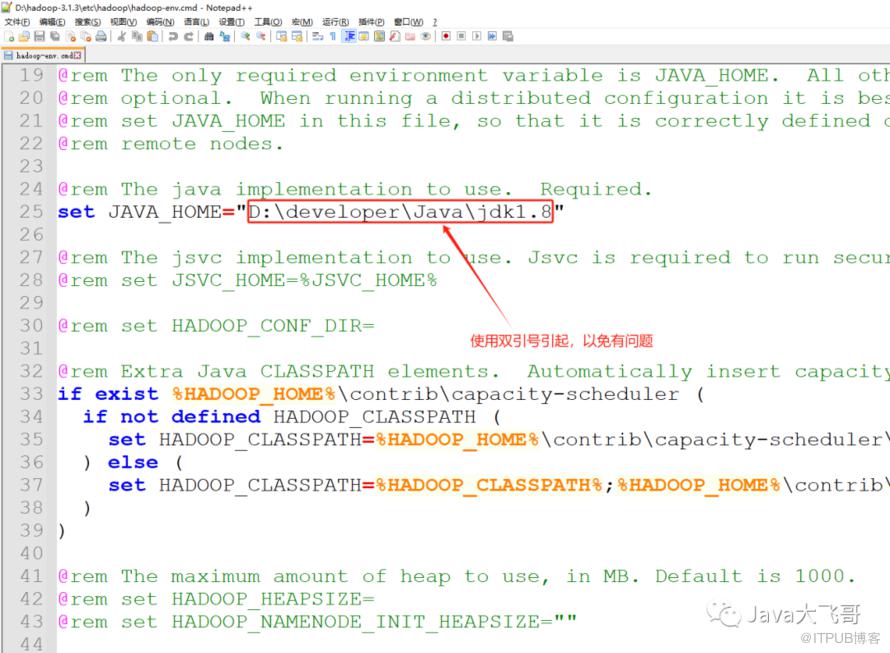

2.4.2.1 修改hadoop-env.cmd文件中的JAVA_HOME路径

原来的配置PROGRA~1是 C:\Program Files 目录的dos文件名模式下的缩写

这个是配置的是本地JDK的安装路径,改成自己的JDK的安装路径即可。

2.4.2.2配置文件core-site.xml

添加如下内容:在configuration标签中添加如下的property标签属性内容

fs.defaultFS

hdfs ://localhost:9000

2.4.2.3配置hdfs-site.xml

添加如下内容:把namenode和datanode的路径改成自己的路径即可

dfs.replication

1

dfs.namenode.name.dir

/D :/hadoop-3.1.3/data/namenode

dfs.datanode.data.dir

/D :/hadoop-3.1.3/data/datanode

2.4.2.4配置mapred-site.xml

添加如下内容:

mapreduce.framework.name

yarn

2.4.2.5配置yarn-site.xml

添加如下内容:

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.nodemanager.aux-services.mapreduce.shuffle.class

org.apache.hadoop.mapred.ShuffleHandler

yarn.nodemanager.resource.memory-mb

1024

yarn.nodemanager.resource.cpu-vcores

1

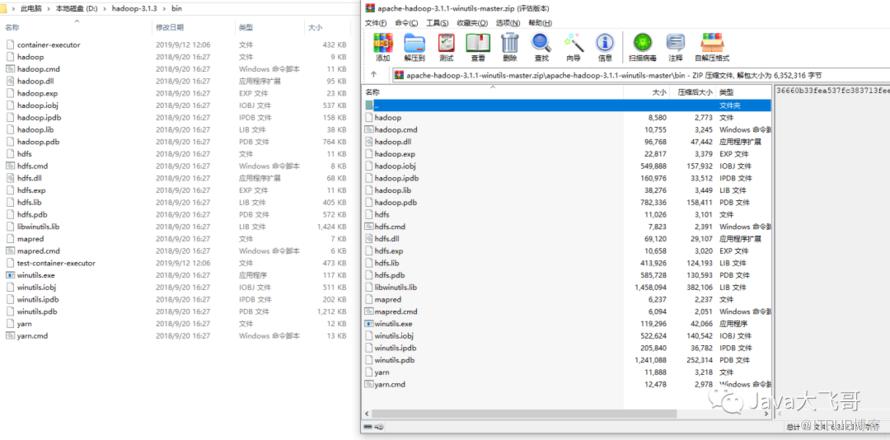

2.4.2.6替换bin目录下的文件

加压winutils文件复制其bin目录下的所有文件覆盖到hadoop-3.1.3\bin中

2.4.2.7 格式化节点

搜索命令提示符右键以管理员身份运行:

hdfs namenode -format

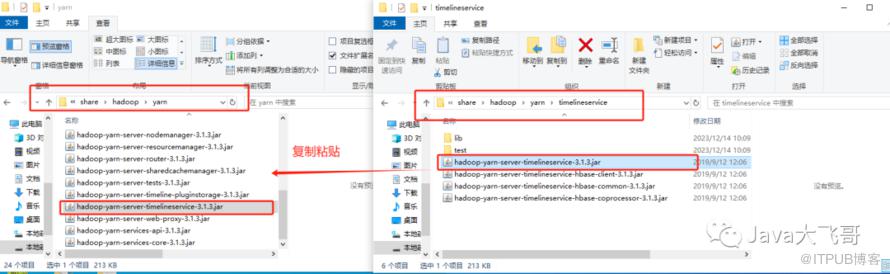

2.4.2.8 复制hadoop-yarn-server-timelineservice-3.1.3.jar

复制D:\hadoop-3.1.3\share\hadoop\yarn\timelineservice\hadoop-yarn-server-timelineservice-3.1.3.jar到D:\hadoop-3.1.3\share\hadoop\yarn目录下

3.验证启动

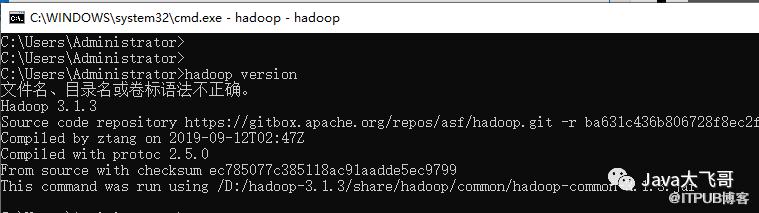

3.1查看hadoop版本

cmd命令提示符中执行以下命令:

hadoop version

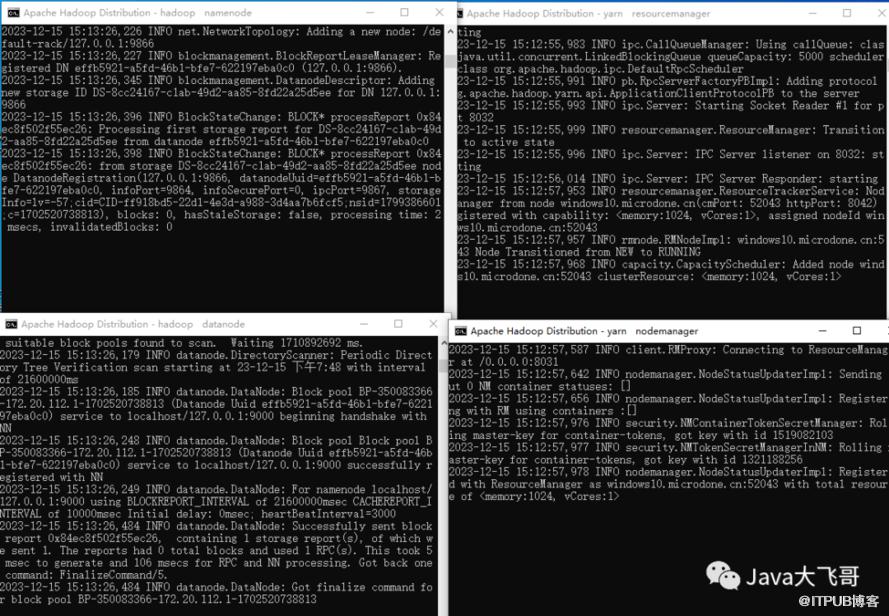

3.2启动

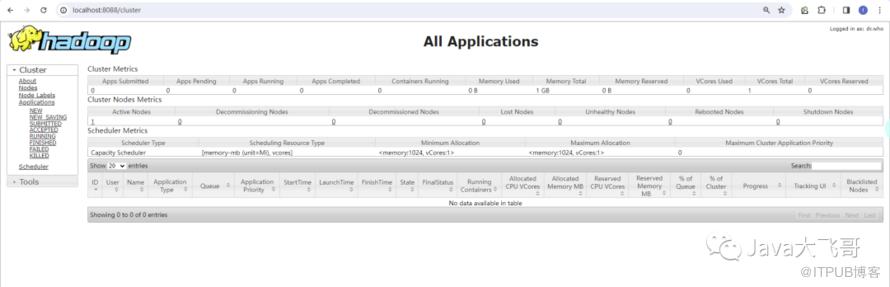

4.访问

浏览器访问

http://localhost:9870/

浏览器访问

http://localhost:8088/