神经网络是近年来备受关注和研究的一个领域,尤其是深度神经网络的出现和发展,不仅在图像、语音、自然语言处理等方面有着广泛的应用,而且被认为是AI技术的核心之一。

1基本原理

神经网络的核心是用神经元模组拟拟人脑的神经系统,由神经元组成一个神经网络。神经元有若干个输入和一个输出,将所有输入加权求和,通过一个非线性激活函数映射为输出。神经网络可以提供机器学习、分类、聚类、回归等功能的支持。

神经网络受到人脑的启发,可模仿生物神经元相互传递信号。神经网络就是由神经元组成的系统。如下图所示,神经元有许多树突 (dendrite) 用来输入,有一个轴突 (axon) 用来输出。它具有两个最主要的特性:兴奋性和传导性。

兴奋性是指当刺激强度未达到某一阈限值时,神经冲动不会发生;而当刺激强度达到该值时,神经冲动发生并能瞬时达到最大强度。

传导性是指相邻神经元靠其间一小空隙进行传导。这一小空隙,叫做突触 (synapse),其作用在于传递不同神经元之间的神经冲动,下图突触将神经元 A 和 B 连在一起。

单层感知机

最早的神经网络结构是单层感知机,仅有一个输出神经元,其输入为一定数量的实值特征。感知机的核心是sigmoid激活函数,用来进行非线性变换,解决数据之间的线性可分问题。

多层神经网络

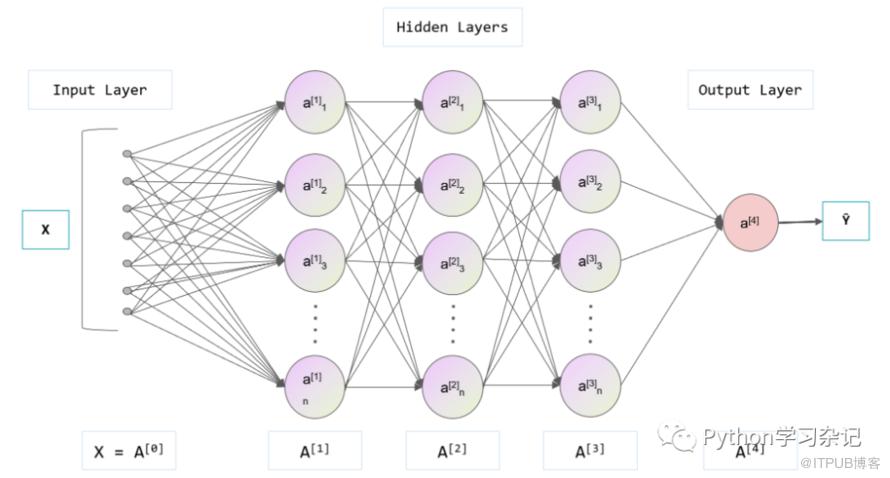

多层神经网络是由多个神经元组成,采用前向传播的方式进行训练。其中包括输入层、隐藏层和输出层。常见的多层神经网络包括全连接神经网络、卷积神经网络和递归神经网络等。

深度神经网络

深度神经网络是多层神经网络的进一步发展,其隐藏层的深度可以在数十或数百以上。深度神经网络的优点是可以对数据进行高级的特征提取和学习,不仅提高模型的准确性,而且可以实现自动化特征抽取。

2应用方向

神经网络可以广泛应用于计算机视觉、自然语言处理、推荐系统、风险评估、金融预测、医学诊断、物流优化等领域。未来,神经网络的应用范围将会进一步扩大,将涉及更多方面,例如自动学习、感知计算、认知能力、分布式智能等等,这将是神经网络未来发展的关注重点之一。

图像分类

使用卷积神经网络进行图像分类任务,可以在ImageNet数据集上获得非常好的成果。基于ResNet、Inception v3等深度神经网络,可以在各个领域获得良好的结果。

语音识别

基于循环神经网络(RNN)、长短时记忆网络(LSTM)等模型,可以准确地识别人类语音中的单词与音节,是语音识别技术的核心。

自然语言处理

基于变换器模型(Transformer)的深度学习语言模型,可以实现在自然语言处理上各项的任务,如机器翻译、文本摘要、情感分析等。

3实现过程举例

用pytorch给一个简单的神经网络案例,

import torch

import torch.nn as nn

import torch.optim as optim

X = torch.randn(100, 20) # 输入数据 (100, 20)

y = torch.randint(0, 2, (100,)) # 目标标签 (100,)

# 定义神经网络结构

class SimpleNet(nn.Module):

def __init__(self):

super(SimpleNet, self).__init__()

self.fc1 = nn.Linear(20, 10) # 输入层到隐藏层 (20, 10)

self.fc2 = nn.Linear(10, 2) # 隐藏层到输出层 (10, 2)

def forward(self, x):

x = torch.relu(self.fc1(x)) # ReLU激活函数

x = self.fc2(x)

return x

# 实例化神经网络

net = SimpleNet()

# 定义损失函数和优化器

criterion = nn.CrossEntropyLoss() # 使用交叉熵损失函数

optimizer = optim.SGD(net.parameters(), lr=0.01) # 使用随机梯度下降优化器

# 训练网络

for epoch in range(10): # 迭代10轮

outputs = net(X) # 前向传播

loss = criterion(outputs, y) # 计算损失

optimizer.zero_grad() # 清零梯度

loss.backward() # 反向传播,计算梯度

optimizer.step() # 更新权重

print(f'Epoch {epoch+1}, Loss: {loss.item()}') # 打印当前轮次和损失值主要数据及参数说明。

X:输入数据,包含100个样本,每个样本有20个特征。

y:目标标签,包含100个目标值。

SimpleNet:定义了一个简单的全连接神经网络,包含两个线性层和一个ReLU激活函数。输入层有20个节点,隐藏层有10个节点,输出层有2个节点。

criterion:定义了交叉熵损失函数,用于计算预测值与真实值之间的差异。

optimizer:定义了随机梯度下降优化器,用于更新神经网络的权重。学习率设置为0.01。

在训练循环中,我们进行前向传播、计算损失、清零梯度、反向传播和更新权重等步骤。每轮训练结束后,打印当前轮次和损失值。4未来展望

未来神经网络将继续发挥重要作用,但是在其应用过程中也面临一些问题,例如欠拟合、过拟合、复杂度计算等方面的瓶颈。另外,神经网络中权重和偏置的初始化、激活函数的选择、优化算法的使用,都需要进一步的研究和解决。