本文将深入探讨DeepSeek-R1如何为RAG应用赋能深度思考。我们把内容分成两篇:

简单的DeepSeek-R1模型替换的“行”与“不行” 基于DeepSeek-R1构建可“深度思考”的Agentic RAG应用

01

DeepSeek-R1替换给RAG带来什么?

在现有的开发平台或框架下,替换RAG底层模型是一件简单的事,因为目前大模型的API大多会默认遵循OpenAI的API规范,对应用层面影响极小。当然在某些环境下,你可能需要对DeepSeek-R1输出中的

直接的DeepSeek-R1模型替换能带来的RAG能力提升在于生成阶段:

检索结果理解:能够更好的理解检索的信息,生成更贴合的结果

推理能力增强:提升面对复杂查询时的准确性和生成质量提升

-

更精细的回复:更好地理解上下文,提升生成文本的流畅性和相关性

有了这些能力提升,RAG将会更擅长完成这样一些输入任务:

根据提供的信息来推理出某个复杂的高阶结果,比如需要数学推理

基于大量事实推理隐藏的关系或识别潜在的模式(GraphRAG的部分能力)

根据特定领域的原理或规则来推理,比如风险识别与问题检测

-

基于已有的事实信息来预测新的问题结果或未来发展趋势等

参考之前曾经介绍过数据增强型LLM应用的4种任务级别(RAG等数据增强型LLM应用的4个任务级别),DeepSeek-R1有助于后三种级别的任务质量提升(隐式事实查询、可解释原理查询、隐藏原理查询):

02

替换DeepSeek-R1模型的潜在问题

所以,DeepSeek-R1应用到RAG有其适应的任务场景与前提,无法做到简单粗暴的性能提升。它也会带来一些新的挑战。这包括:

【推理速度的下降】

这是推理模型的"think"过程导致。尽管流式(Streaming)输出可以适当改善用户感官上的体验,但在企业环境下,很多时候RAG管道会被用作某个上层应用(比如Agent甚至传统CRM)的基础工具,这就需要充分评估其带来的关联影响。

【计算资源的消耗】

为了达到最好的效果,你可能需要私有部署DeepSeek-R1满血版,这需要较高的计算资源消耗,以及部署与维护的成本。如果借助开放API,一方面目前普遍性能不够理想,同时推理Tokens成本也会上升。

【不适合的RAG任务】

简单的说,DeepSeek-R1擅长的深度思考并非所有的RAG任务都需要。事实上很多企业RAG应用的查询任务都是以事实性提问为主的简单推理任务,这一类任务目前的类似DeepSeek-V3这样的通用模型也能胜任,且优化更需要关注在索引与检索阶段,而非生成阶段的模型。而且从用户角度,回答一个类似下图的问题,并不需要长长的思考过程来把简单问题复杂化。

【小心可能的幻觉问题】

需要注意的是,在Vectara的幻觉标准测试中,DeepSeek-R1的幻觉率是较高的,而RAG的意义就是要降低幻觉以提高准确性,两者存在一定的冲突。在实际的测试中(特别是开源的DeepSeek蒸馏模型)也的确存在这样的现象,一个可能的原因是:

RAG是一种在提供的参考知识范围内来推理结果的应用,但如果参考知识本身并没有提供推理所需的材料,无论你如何“深度”的思考,本质上是无法得出正确答案的;或者就会导致“用力过猛”,过度延伸而导致幻觉问题。

DeepSeek-R1模型本身的训练特点也强化了这一点:

DeepSeek-R1针对思维链(CoT)任务(如数学、编程等)等进行优化训练,导致对于简单的任务也会进行不同角度的理解与延伸,杀鸡用宰牛刀,容易发生偏离与幻觉,特别是低训练参数的蒸馏模型。 DeepSeek-R1的训练对于语言类的“文科”任务鼓励创造性与发散性思维。这对于需要创造力的任务(如一篇文彩飞扬的文章)来说是好事,但对于RAG这种要求准确性的语任务会产生副作用。

03

一个简单的幻觉测试

我们用一个例子来简单体验下DeepSeek-R1模型的幻觉问题(注意这不是一个严谨的评估测试)。

【测试环境】

文档:DeepSeek-R1论文中文翻译版本

向量库/嵌入模型:Chroma/text-embedding-3-small

框架:LlamaIndex

-

LLM:DeepSeek系列模型、qwen2.5、gpt-4o-mini

【测试问题】

在AIME基准测试中使用多数投票后DeepSeek-R1-Zero的性能提升了多少?比DeepSeek-X1模型提升了多少?

这个问题的前半部分是一个简单的带数学计算的事实性推理问题,而后半部分则是一个虚构的问题(不存在DeepSeek-X1)。在其他条件保持不变的情况下,我们仅更换生成阶段的大模型,每个模型做6次测试。

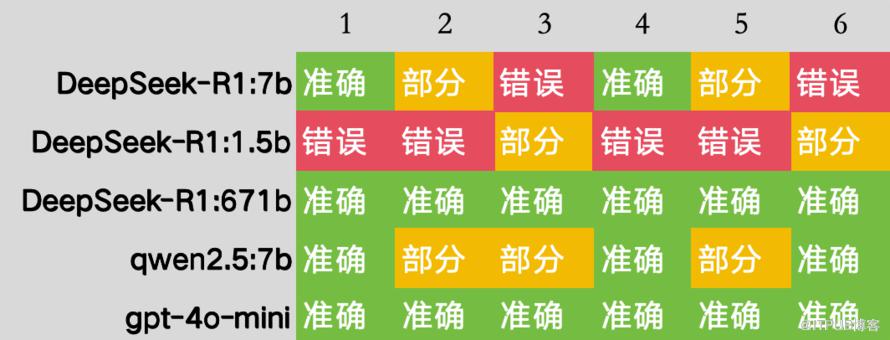

【测试结果】

最后的结果如下:

评估标准说明:

准确:能够准确的推理出前半部分的答案,并说明不存在X1这个模型

错误:前半部分的答案错误,后半部分出现幻觉

部分:前半部分的答案正确,后半部分出现幻觉。在过程中又观察到多种情况:

选择性的忽略了后半部分的问题,即完全无视

基于上下文进行假设,然后推理出基于假设的答案

-

无任何说明的纯粹编造(主要是DeepSee-R1:1.5b)

尽管单个样本的测试不能代表全部,但结果也基本符合我们的预期:

开源的DeepSeek模型幻觉很严重,不建议在生产环境中使用

官方DeepSeek的满血版有较好的幻觉控制,问题是延时太长

简单的推理任务,即使是开源的通用模型也能有不错表现,比如qwen2.5

04

“深度思考”如何赋能更多场景

简单总结:尽管简单的升级模型到DeepSeek-R1在某些复杂任务下可以产生立竿见影的效果,但同时也要警惕它的副作用,如过度推理、响应变慢甚至幻觉等。

但在实际应用中又的确存在需要结合RAG的准确性与“深度思考”能力的场景。比如:

回答研究型问题。如“DeepSeek模型训练技术细节?”

结合公司自身产品信息与互联网,生成市场分析报告

根据领导提供的文档与报告,生成汇报PPT材料

-

根据已有的大量文档创建一篇自媒体文章

显然在这些场景中,仅更换生成模型是远远不够的。事实上,在RAG优化的大量“花活”中,更多的是针对更好的理解输入问题,并提高检索的精准度而优化。所以需要从全流程上考虑这些场景如何与DeepSeek及RAG技术相结合,接下来我们将构建一个基于DeepSeek-R1/gpt-4o + Agentic RAG的可“深度思考”的研究助手。这个应用可以根据需要在必要时打开“深度思考”开关,以利用后端强大的Agentic RAG展开深度的主题研究。

end

福利时间

为了帮助LLM开发人员更系统性与更深入的学习RAG应用,特别是企业级的RAG应用场景下,当前主流的优化方法与技术实现,我们编写了《基于大模型的RAG应用开发与优化 — 构建企业级LLM应用》这本长达500页的开发与优化指南,与大家一起来深入到LLM应用开发的全新世界。

更多细节,点击链接了解

此处购买享优惠